Ein Facebook-Nutzer meldet sich bei aufgedeckt24.de mit einem ungewöhnlichen, aber gut dokumentierten Fall: Sein seit rund 20 Jahren bestehendes Konto wird plötzlich blockiert. Facebook verlangt eine Video-Identitätsprüfung per Selfie – andernfalls droht nach 111 Tagen die endgültige Löschung. Einen konkreten Vorwurf, eine nachvollziehbare Begründung oder eine echte Widerspruchsmöglichkeit gibt es nicht. Dieser Artikel ordnet den Fall ein, zeigt Parallelen zu ähnlichen Berichten und stellt die Frage, ab wann eine angeblich „freiwillige Verifikation“ zur faktischen Bedingung wird.

Ausgangslage: Facebook-Checkpoint statt direkter Sperre

Bevor wir in die Details gehen, muss ich einen Punkt sauber geradeziehen – weil genau da oft schon das erste Missverständnis entsteht: Hier geht es nicht um meine eigene Facebook-Erfahrung, sondern um den Erfahrungsbericht eines aufgedeckt24-Lesers (Alexander), der sich bei mir gemeldet und Screenshots mitgeschickt hat.

Und was bei ihm passiert ist, ist keine klassische „Sperre mit sofortigem Knockout“ – also nicht dieses „Konto deaktiviert, fertig, Ende“. Stattdessen hat Facebook (bzw. Meta) eine Variante gewählt, die auf dem Papier harmloser klingt, in der Praxis aber genauso bitter enden kann:

Was ist ein „Checkpoint“ überhaupt?

Ein Checkpoint ist vereinfacht gesagt eine Art Zwangs-Zwischenstopp. Facebook lässt dich nicht mehr normal ins Konto rein, sondern sagt sinngemäß:

„Moment. Erst musst du beweisen, dass du du bist – sonst geht hier gar nichts mehr.“

Das ist also keine endgültige Sperre in dem Sinne, dass sofort alles weg ist. Es ist eher eine Blockade, die erst dann verschwindet, wenn du eine bestimmte Aktion ausführst. Und genau diese Aktion ist in diesem Fall die berühmte „Identitätsprüfung“.

Warum das trotzdem wie eine Sperre wirkt

Jetzt kommt der entscheidende Punkt: Für Betroffene fühlt sich so ein Checkpoint fast identisch an wie eine Sperre, weil:

- du kommst nicht mehr richtig rein,

- du kannst nichts mehr machen,

- du hast faktisch keinen Zugriff mehr,

- und du hängst an einer Bedingung, die du entweder erfüllst oder eben nicht.

Der Leser beschreibt das sehr klar: Er sieht das als eine Art Ultimatum, weil Facebook eine Frist setzt und gleichzeitig droht, was passiert, wenn man nicht mitmacht.

Und damit sind wir bei dem Teil, der den Checkpoint so unangenehm macht:

„Nicht gesperrt“ – aber mit Ablaufdatum

In Alexanders Fall ist es nicht „sofort weg“, sondern nach dem Motto:

- Du hast X Tage Zeit, diese Prüfung zu machen.

- Wenn du es nicht machst, wird das Konto dauerhaft und unwiederbringlich entfernt.

Das ist psychologisch ziemlich geschickt aufgebaut: Es klingt zunächst nach „alles halb so wild“, ist aber im Kern eine klare Ansage. Denn am Ende läuft es auf eine simple Frage hinaus:

Bist du bereit, dich so zu verifizieren, wie Facebook das verlangt – ja oder nein?

Wenn ja: vielleicht bekommst du dein Konto wieder.

Wenn nein: Konto weg.

Und genau deshalb sollte man sich von dem Wort „vorübergehend“ nicht einlullen lassen. Vorübergehend ist hier nicht automatisch harmlos – es ist eher die „Wartehalle“, bevor es endgültig wird.

Der Unterschied zur direkten Sperre – und warum er wichtig ist

Warum betone ich diese Unterscheidung so? Weil man dadurch viel klarer beschreiben kann, was Meta hier eigentlich macht:

- Bei einer direkten Sperre ist die Botschaft: „Du bist raus.“

- Bei einem Checkpoint ist die Botschaft: „Du darfst bleiben – wenn du tust, was wir verlangen.“

Das ist ein wichtiger Unterschied. Nicht nur sprachlich, sondern auch in der Wirkung: Ein Checkpoint ist oft weniger offensichtlich angreifbar („Wir geben dir doch eine Chance!“), kann aber für den Betroffenen am Ende genau dasselbe Ergebnis haben.

Und genau darum geht’s in diesem Artikel

Dieser Beitrag soll daher nicht einfach „Facebook sperrt grundlos“ schreien, sondern sauber zeigen:

- Was genau Facebook fordert

- welche Konsequenzen daran hängen

- und warum das für normale Nutzer (und erst recht für kleine Projekte) ein echtes Problem ist

Denn am Ende ist es egal, wie Facebook das Label nennt – Checkpoint, Sicherheitsüberprüfung, Identitätsprüfung oder sonstwas. Entscheidend ist:

Du kommst ohne Mitmachen nicht weiter. Und wenn du nicht mitmachst, kann dein Konto endgültig verschwinden.

Im nächsten Kapitel schauen wir uns deshalb konkret an, was Alexander am 21.01.2026 angezeigt bekommen hat, inklusive der Formulierungen und der Forderung nach Video-Ident.

Der konkrete Fall: Was Alexander passiert ist

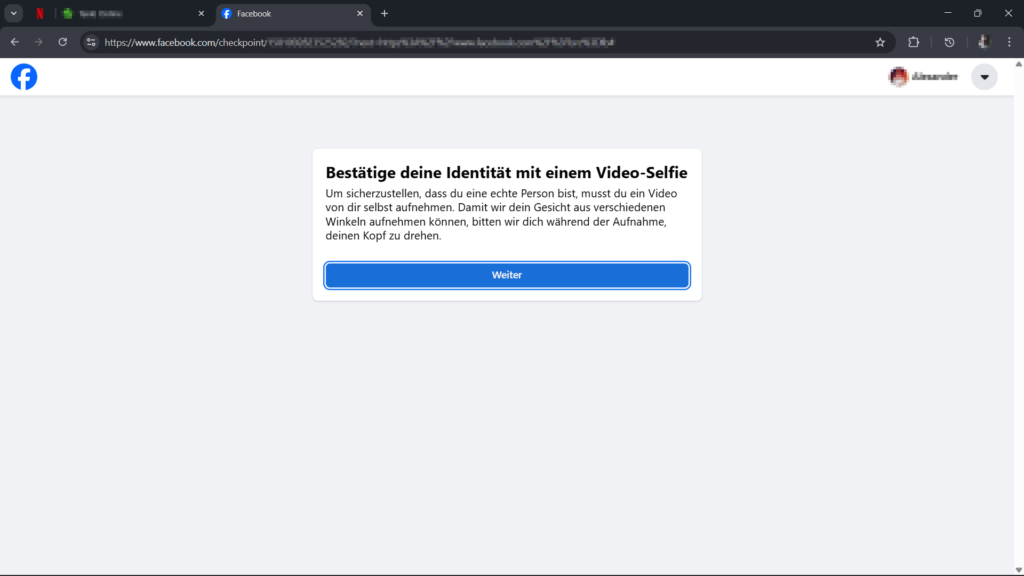

Kommen wir zum eigentlichen Kern dieses Artikels: dem Erfahrungsbericht eines aufgedeckt24-Lesers. Alexander hat sich über das Hinweisformular gemeldet, später ergänzt und zwei Screenshots mitgeschickt. Dadurch ist der Fall nicht nur eine subjektive Schilderung, sondern konkret belegbar.

Wichtig vorweg: Laut Alexander handelt es sich (noch) nicht um eine sofortige, endgültige Facebook-Sperre, sondern um einen sogenannten Checkpoint. Sein Konto ist blockiert, solange er eine von Facebook geforderte Identitätsprüfung nicht durchführt.

Ein Detail, das man nicht übersehen sollte: ein fast so alter Account wie Facebook selbst

Besonders bemerkenswert ist dabei ein Punkt, den Alexander eher beiläufig erwähnt:

Sein Facebook-Konto besteht seit rund 20 Jahren.

Zur Einordnung: Facebook selbst existiert erst seit 2004. Ein Account mit dieser Laufzeit gehört also praktisch zur ersten Generation der Plattform. Es handelt sich nicht um ein neu angelegtes Profil, nicht um ein Wegwerf-Konto und ganz sicher nicht um das typische Muster eines automatisierten Spam- oder Bot-Accounts.

Gerade vor diesem Hintergrund wirkt der spätere „Bot-Verdacht“ mindestens erklärungsbedürftig.

Ausgangslage: Politische Diskussionen und zunehmende Eskalation

Alexander schildert, dass er in letzter Zeit verstärkt politische Inhalte gelesen und diskutiert hat, vor allem in Gruppen. Ziel war nach eigener Aussage, sich ein Bild von Meinungen zu machen und sich teilweise auch aktiv zu beteiligen. Dabei unterstützte er in Diskussionen eine Partei, deren Programm ihn überzeugt.

Welche Partei das konkret ist, lasse ich hier bewusst offen. Für den technischen Ablauf des Falls ist das nicht entscheidend – und es verhindert, dass der Fokus unnötig von der eigentlichen Problematik abgelenkt wird.

Wichtig ist: Kurz darauf griff Facebook ein.

Der Eingriff durch Facebook: kein Vorwurf, keine Erklärung

Am Mittwoch, den 21.01.2026, wurde sein Konto plötzlich durch Facebook blockiert. Die angezeigte Meldung lautete sinngemäß:

„Um sicherzugehen, dass Sie kein Bot sind, führen Sie bitte folgende Identitätsprüfung durch.“

Das ist alles.

Kein Hinweis auf einen bestimmten Beitrag.

Kein Kommentar.

Kein konkreter Regelverstoß.

Stattdessen ein pauschaler Bot-Verdacht, der automatisch eine Identitätsprüfung auslöst.

Gerade bei einem Account, der laut Nutzerangabe seit etwa zwei Jahrzehnten existiert, wirkt dieser Schritt zumindest erklärungsbedürftig. Doch genau diese Erklärung bleibt Facebook schuldig.

Die Frist: 111 Tage – danach ist alles weg

Facebook belässt es nicht bei einer unverbindlichen Aufforderung. Ab dem 21.01.2026 wurde Alexander eine klare Frist gesetzt:

- 111 Tage Zeit, um die Identitätsprüfung durchzuführen

- keine Durchführung innerhalb dieser Frist bedeutet: dauerhafte und unwiederbringliche Entfernung des Kontos

Damit wird aus einer angeblichen Sicherheitsmaßnahme ein Ultimatum mit Ablaufdatum. Der Account ist zwar formal nicht sofort gelöscht, praktisch aber blockiert – mit einem festen Endpunkt.

Warum Alexander die Identitätsprüfung verweigert

Alexander hat sich bewusst entschieden, diese Video-Identitätsprüfung nicht durchzuführen. Seine Gründe sind nachvollziehbar:

- Er soll ein Video von sich aufnehmen bzw. hochladen.

- Es bleibt unklar, wer dieses Video prüft.

- Es ist nicht transparent, wie lange die Daten gespeichert werden.

- Es gibt keine echte Kontrolle oder Einsicht in den Prozess.

Hinzu kommt: Alexander verweist darauf, dass er in Kommentaren und Erfahrungsberichten gelesen habe, dass selbst eine erfolgreiche Identitätsprüfung nicht automatisch zur Freigabe des Kontos führt. Ob das in jedem Fall zutrifft, lässt sich nicht pauschal überprüfen – aber die Unsicherheit ist real und weit verbreitet.

Und genau diese Unsicherheit verschärft die Lage: Man soll sensible Daten liefern, ohne Garantie, dass das Konto danach tatsächlich wieder freigegeben wird.

Was die Screenshots zeigen

Die von Alexander übermittelten Screenshots bestätigen den Ablauf:

- keine alternative Verifikation

- keine Möglichkeit, auf anderem Weg Vertrauen herzustellen

- keine konkrete Begründung für den Bot-Verdacht

Stattdessen: Video-Ident oder Kontoverlust.

Warum dieser Fall so typisch – und so problematisch ist

Fasst man den Ablauf zusammen, ergibt sich ein klares Bild:

- Facebook äußert einen pauschalen Bot-Verdacht

- Es wird eine Video-Identitätsprüfung verlangt

- Eine feste Frist wird gesetzt

- Bei Verweigerung droht die endgültige Kontolöschung

Das ist keine freiwillige Sicherheitsabfrage, sondern eine Entscheidung unter Druck. Besonders brisant wird das Ganze, wenn man berücksichtigt, dass es hier um ein Konto geht, das offenbar seit fast zwei Jahrzehnten besteht.

Im nächsten Kapitel schauen wir uns deshalb genauer an, wie diese Video-Ident-Prüfung konkret abläuft, was Facebook damit erreichen will – und warum gerade dieser Schritt so viele Fragen offenlässt.

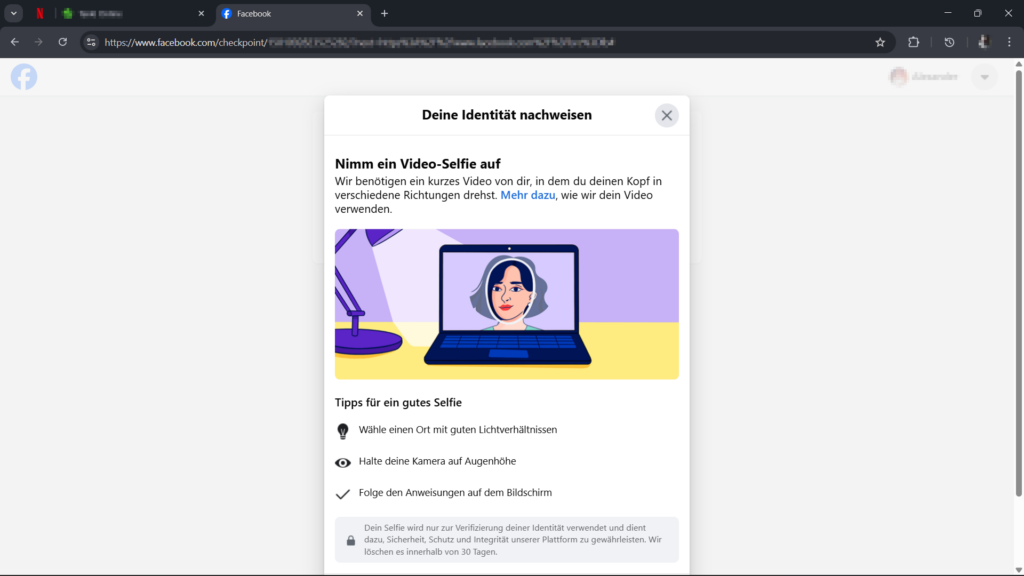

Die geforderte Maßnahme: Video-Ident per Selfie

Spätestens an diesem Punkt wird aus einem „Sicherheitscheck“ etwas, das viele Betroffene eher als Zwangsmaßnahme empfinden: Facebook verlangt keine einfache Bestätigung per E-Mail, keinen Code per SMS und auch keine Sicherheitsfrage – sondern ein Video-Selfie.

Und genau das ist der Kern des Problems: Ein Video-Selfie ist nicht nur irgendeine technische Hürde. Es ist eine Form der biometrischen Identitätsprüfung – also etwas, das deutlich sensibler ist als „Passwort vergessen“.

Was Facebook in diesem Fall konkret verlangt

Laut den Screenshots, die Alexander mitgeschickt hat, läuft es auf eine klare Ansage hinaus:

Um „sicherzugehen“, dass er kein Bot ist, soll er eine Identitätsprüfung durchführen. Diese besteht aus einem kurzen Video, bei dem die Kamera aktiv sein muss.

Ganz typisch bei dieser Art Checkpoints (und so sieht es auch hier aus):

- Kamera einschalten

- das Gesicht wird erfasst

- man soll den Kopf bewegen (z. B. nach links und rechts drehen)

- manchmal zusätzlich nach oben/unten schauen

Der Zweck ist dabei offensichtlich: Facebook will prüfen, ob da ein echter Mensch sitzt – und nicht ein statisches Foto oder ein automatisierter Zugriff. Technisch ist das eine „Liveness“-Prüfung: Bewegung, Perspektive, echte Mimik – irgendetwas, das nicht so leicht zu fälschen ist.

So weit, so nachvollziehbar.

Nur ist „nachvollziehbar“ nicht automatisch „okay“.

Warum das nicht einfach nur ein harmloser Bot-Check ist

Ein Video-Selfie ist kein Einmalcode. Kein temporärer Schlüssel. Kein „ich bestätige kurz meine Nummer“.

Ein Video-Selfie ist:

- dein Gesicht

- deine Bewegungen

- dein biometrisches Muster

Und damit sind wir genau bei dem Punkt, der viele (und Alexander eben auch) stutzig macht:

Wer prüft das eigentlich?

Mensch oder Maschine?

Und was passiert mit dem Video danach?

Facebook erklärt diesen Teil in der Praxis oft nur sehr vage. Für Betroffene bleibt das Ganze eine Blackbox: Man wird aufgefordert, ein Video zu liefern – aber man bekommt keine wirklich greifbare Antwort darauf, wie entschieden wird und was mit dem Material passiert.

Die „Freiwilligkeit“, die keine ist

Facebook verkauft das als Sicherheitsmaßnahme. In Alexanders Fall steht dahinter aber eine klare Konsequenz:

- Entweder: Video-Ident durchführen

- Oder: Konto nach Ablauf der Frist dauerhaft weg

Das ist keine echte Wahlfreiheit. Es ist eher wie ein Türsteher, der sagt:

„Du kannst natürlich draußen bleiben – aber dann kommst du eben nicht rein.“

Und genau deshalb ist Alexanders Reaktion nicht „Sturheit“, sondern eine nachvollziehbare Abwägung: Er will nicht, dass irgendein unbekannter Prozess sein Gesichtsvideo bewertet – und damit letztlich über die Existenz seines Kontos entscheidet.

Alexanders Hauptkritik: fehlende Kontrolle

Alexander schreibt sinngemäß: Er wird ganz sicher kein Video von sich drehen, wenn er nicht weiß,

- wer das Video sieht,

- wer darüber entscheidet,

- und wie damit umgegangen wird.

Das ist ein Punkt, den man nicht wegwischen kann – denn genau diese Infos fehlen Betroffenen in der Regel. Und selbst wenn irgendwo in Hilfetexten etwas steht, bleibt es für Nutzer oft schwammig oder schwer greifbar.

Noch unangenehmer wird es dadurch, dass Alexander zusätzlich von Berichten gelesen hat, wonach selbst nach erfolgreicher Identitätsprüfung das Konto nicht zwingend wieder freigegeben wird. Ob das in jedem Einzelfall stimmt, sei dahingestellt – aber schon die Tatsache, dass diese Sorge so verbreitet ist, zeigt das Grundproblem:

Man soll liefern – aber man weiß nicht, ob es überhaupt etwas bringt.

Warum diese Maßnahme so eskalationsanfällig ist

Was viele unterschätzen: Bei so einer Video-Prüfung kann schon Kleinkram schiefgehen, ohne dass der Nutzer etwas „falsch“ gemacht hätte:

- Kameraqualität schlecht

- Licht ungünstig

- Gesicht teilweise verdeckt (Brille, Haare, Schatten)

- System erkennt die Bewegungen nicht richtig

- oder die Entscheidung läuft automatisiert und fällt „negativ“ aus

Und wenn danach keine zweite Chance kommt, kein menschlicher Kontakt und kein ordentliches Widerspruchsverfahren, bleibt am Ende genau das, was Alexander befürchtet: ein automatisches Urteil ohne echte Korrekturmöglichkeit.

Warum die Maßnahme gerade bei alten Accounts seltsam wirkt

Nochmal: Wir reden hier über ein Konto, das laut Alexander seit rund 20 Jahren existiert – also praktisch so lange, wie Facebook selbst.

Natürlich kann auch ein alter Account gehackt werden, klar. Aber dann wäre die logische Maßnahme eher:

- Passwort ändern

- Zugriff absichern

- verdächtige Logins prüfen

Stattdessen kommt gleich die große Keule: Video-Ident.

Und das fühlt sich für viele nicht wie „Sicherheit“ an, sondern eher wie:

„Mach das – oder du bist raus.“

Zwischenfazit

Unterm Strich ist die Video-Ident-Prüfung in Alexanders Fall kein kleines Hindernis, sondern die zentrale Weiche:

- Wer sie macht, hofft auf Freigabe.

- Wer sie nicht macht, riskiert die komplette Löschung.

Und genau deshalb ist die nächste Frage so wichtig:

Was passiert danach – und welche Konsequenzen hängen an dieser Frist?

Im nächsten Kapitel geht’s deshalb um den Punkt, der das Ganze endgültig in Richtung Ultimatum kippen lässt: die 111 Tage Frist – und die drohende irreversible Kontolöschung.

Die Frist und ihre Konsequenzen: 111 Tage bis zur endgültigen Löschung

Was Facebook in diesem Fall vorgibt, ist eine Frist.

Was es faktisch ist, fühlt sich für den Betroffenen eher wie ein Countdown mit festem Ausgang an.

Denn seit dem 21.01.2026 ist Alexanders Konto vollständig blockiert. Es handelt sich nicht um eine Einschränkung einzelner Funktionen oder um einen „eingeschränkten Modus“, sondern um einen kompletten Stillstand.

Kein eingeschränkter Zugriff – gar kein Zugriff

Das ist wichtig klarzustellen, weil es die Situation deutlich verändert:

- Alexander kann sein Konto überhaupt nicht mehr nutzen.

- Er kann nichts posten, nichts kommentieren, nichts lesen.

- Er hat keinen Zugriff auf Inhalte, Nachrichten oder Einstellungen.

- Das Konto existiert faktisch nur noch als Hülle mit einer einzigen Funktion:

die Aufforderung zur Identitätsprüfung.

Von „vorübergehend eingeschränkt“ kann hier also keine Rede sein. Das Konto ist eingefroren – und bleibt es, bis entweder die geforderte Maßnahme durchgeführt wird oder die Frist abläuft.

Die Frist: 111 Tage mit klarer Drohkulisse

Facebook setzt in diesem Fall eine Frist von 111 Tagen. Innerhalb dieses Zeitraums soll die Video-Identitätsprüfung durchgeführt werden. Passiert das nicht, lautet die angekündigte Konsequenz unmissverständlich:

Das Konto wird dauerhaft und unwiederbringlich entfernt.

Diese Formulierung lässt keinen Spielraum. Es gibt keinen Hinweis auf eine erneute Prüfung, keinen nachgelagerten Widerspruch und keine zweite Chance. Läuft die Frist ab, ist das Konto weg – inklusive aller Inhalte, Kontakte und Verknüpfungen.

Warum das keine echte „Frist“ ist

Auf dem Papier wirkt das zunächst fair: Man bekommt Zeit.

In der Realität ist diese Zeit jedoch an genau eine einzige Handlungsoption geknüpft.

Denn während die Uhr läuft:

- gibt es keinen alternativen Verifizierungsweg

- keinen erreichbaren Support

- keine Möglichkeit, die Entscheidung überprüfen zu lassen

- keine Transparenz über den weiteren Ablauf

Die Frist dient damit nicht der Klärung, sondern dem Aufbau von Druck. Sie gibt dem Betroffenen nicht mehrere Optionen, sondern nur eine einzige – und verpackt diese als freiwillige Entscheidung.

„Video oder Löschung“ – eine Wahl nur auf dem Papier

Am Ende läuft das Ganze auf ein schlichtes Entweder-oder hinaus:

- Video-Ident durchführen – mit ungewissem Ausgang

- oder nichts tun – und das Konto verlieren

Facebook spricht von einer Sicherheitsmaßnahme. Für den Betroffenen ist es eine Zwangslage. Denn wer sich bewusst gegen die Video-Ident-Prüfung entscheidet, verliert alles. Und wer mitmacht, hat keine Garantie, dass das Konto tatsächlich wieder freigegeben wird.

Eine echte Wahlfreiheit sieht anders aus.

Oder anders gesagt:

Man kann es nennen, wie man will – eine Frist ist das nur auf dem Papier. In der Praxis bleibt ein klassisches „Video oder Löschung“-Szenario. Ein modernes „Friss oder stirb“, technisch sauber formuliert und freundlich verpackt, aber in der Wirkung gnadenlos eindeutig.

Zwischenfazit

Die 111 Tage sind keine neutrale Übergangsphase. Sie sind der Mechanismus, mit dem Facebook den Druck erhöht und die Entscheidung erzwingt. Wer kein Video liefern will, verliert sein Konto. Wer es liefert, hofft auf Gnade eines intransparenten Systems.

Im nächsten Kapitel geht es genau um diese Entscheidung:

Warum Alexander diesen Weg bewusst nicht mitgeht – und warum viele andere an genau dieser Stelle ebenfalls aussteigen würden.

Entscheidung unter Zwang: Zustimmung oder Kontoverlust

Spätestens hier wird klar, warum ich dieses Vorgehen nicht einfach als „Sicherheitsprüfung“ stehen lassen kann. Denn was Facebook in Alexanders Fall daraus macht, ist keine normale Schutzmaßnahme, sondern eine Entscheidung unter Druck.

Auf dem Papier sieht es harmlos aus: „Bitte bestätigen Sie, dass Sie kein Bot sind.“

In der Praxis läuft es auf genau zwei Optionen hinaus:

- Zustimmen und das Video liefern

- Nicht zustimmen – und das Konto verlieren

Das ist der Kern. Und genau deswegen spricht Alexander nicht von einer „Frist“, sondern von einer Situation, in der er sich praktisch in die Ecke gedrängt fühlt.

Warum das keine echte Wahl ist

Eine Wahl setzt voraus, dass beide Optionen realistisch und fair sind.

Hier ist es aber so:

- Die eine Option bedeutet: biometrische Daten abliefern (Video-Selfie).

- Die andere Option bedeutet: kompletter Verlust eines Kontos, das – laut Alexander – seit rund 20 Jahren existiert.

Das ist keine Entscheidung zwischen zwei gleichwertigen Alternativen. Das ist eine Entscheidung zwischen:

„Mach mit“ oder „alles ist weg“

Und genau dadurch wird aus einer Sicherheitsmaßnahme eine Zwangslage. Facebook kann das natürlich als „freiwillig“ verkaufen – aber wenn die Konsequenz bei Verweigerung die Löschung ist, ist das Wort freiwillig ziemlich dehnbar.

Alexanders Position: „Ich mache da nicht mit“

Alexander sagt ziemlich klar, warum er das ablehnt: Er wird kein Video von sich drehen, wenn er nicht weiß,

- wer sich dieses Video am Ende anschaut,

- wie genau bewertet wird,

- und was mit den Daten passiert.

Das ist keine Paranoia, das ist eine völlig normale Frage. Es geht hier nicht um einen Login-Code, sondern um etwas sehr Persönliches: das eigene Gesicht als Datenmaterial.

Und genau das ist der Punkt, an dem viele sagen: „Moment mal – warum muss ich dafür ein Video liefern?“

Die Unsicherheit ist Teil des Problems

Ein weiterer Punkt, der in Alexanders Nachricht mitschwingt: Er hat in Kommentaren und Erfahrungsberichten gelesen, dass selbst nach erfolgreicher Identitätsprüfung eine Freigabe des Kontos ausbleibt.

Ob das in jedem Fall stimmt, kann man nicht pauschal behaupten. Aber das Entscheidende ist: Diese Unsicherheit existiert.

Und sie ist fatal, weil sie die Situation noch absurder macht:

- Du sollst sensible Daten liefern,

- aber du bekommst keine Garantie,

- und du hast keinen Plan, ob es überhaupt etwas bringt.

Das Entscheidende ist die Unsicherheit. Der Nutzer soll sensible Daten liefern, ohne zu wissen, ob das überhaupt etwas bringt. Nicht einmal die Rückgabe des eigenen Kontos ist garantiert – obwohl genau das der Zweck der gesamten Maßnahme sein soll.

Die eigentliche Frage: Warum ausgerechnet Video?

Wenn Facebook wirklich nur sicherstellen wollte, dass da ein Mensch sitzt, gäbe es auch weniger invasive Möglichkeiten:

- Bestätigung über bereits hinterlegte Faktoren

- Login-Historie prüfen

- 2FA / Sicherheitsabfrage

- schriftliche Verifikation

- oder zumindest alternative Wege

Aber hier gibt es offenbar nur diesen einen Weg. Und das wirkt nicht wie „Sicherheit“, sondern wie ein System, das darauf ausgelegt ist, Betroffene in eine einzige Richtung zu drücken.

Druck durch Zeit: Die 111 Tage verstärken den Zwang

Der Zwang entsteht nicht nur durch die Maßnahme selbst, sondern auch durch den Rahmen:

- Konto ist nicht nutzbar

- Frist läuft

- danach ist alles weg

Dadurch wird die Entscheidung nicht in Ruhe getroffen, sondern unter Druck. Und der Druck wird über Zeit aufgebaut: Je näher das Ende der Frist rückt, desto mehr steigt die Wahrscheinlichkeit, dass viele am Ende doch „zustimmen“, einfach weil sie ihr Konto nicht verlieren wollen.

Das ist aus Sicht eines Konzerns natürlich praktisch. Aus Sicht des Nutzers ist es ein mieses Spiel.

Was dabei untergeht: das Prinzip „ich muss mich nicht beweisen“

Der eigentliche Skandal ist nicht mal, dass es eine Identitätsprüfung gibt. Die kann in bestimmten Fällen sinnvoll sein.

Das Problem ist:

- Keine konkrete Begründung, warum ausgerechnet dieser Account verdächtig ist

- keine Transparenz, wie die Prüfung funktioniert

- keine Alternative

- und keine echte Möglichkeit, sich dagegen zu wehren

Am Ende bleibt beim Nutzer nur das Gefühl, sich beweisen zu müssen – gegenüber einem System, das nicht erklärt, warum es überhaupt Zweifel hat.

Und gerade bei einem langjährig bestehenden Account wirkt dieses „Beweis mal, dass du echt bist“ besonders schräg.

Fazit dieses Kapitels

Alexanders Fall zeigt sehr gut, wie sich Plattformmacht im Alltag anfühlt: Nicht als offener Bann mit Begründung, sondern als technisch sauber formulierter Zwang.

Facebook nennt es „Identitätsprüfung“.

De facto ist es eine Entscheidung zwischen:

- Zustimmung zur Video-Prüfung

- oder Kontoverlust

Und genau deshalb ist Alexanders Haltung nachvollziehbar – auch wenn sie ihn am Ende sein Konto kosten könnte.

Im nächsten Kapitel schauen wir uns an, warum sein Fall kein Einzelfall ist, welche Parallelen es zu anderen bekannten Fällen gibt – und wie solche Checkpoints inzwischen fast schon zum Standardwerkzeug geworden sind.

Parallelen zu bereits bekannten Fällen

Alexanders Fall wirkt auf den ersten Blick individuell – politischer Kontext, langjähriger Account, Video-Ident mit Frist. Schaut man genauer hin, zeigt sich jedoch schnell: Das Muster ist alles andere als neu. Die Details variieren, der Ablauf bleibt erstaunlich konstant.

Immer derselbe Mechanismus

In vielen Berichten, die man online findet – in Foren, Kommentarspalten oder Hilfegruppen – tauchen dieselben Elemente immer wieder auf:

- ein plötzlich gesetzter Checkpoint

- ein pauschaler Bot- oder Sicherheitsverdacht

- die Forderung nach Video-Ident per Selfie

- eine Frist mit der Drohung der endgültigen Löschung

- und am Ende: keine echte Kommunikation

Ob es sich um private Profile, Seitenbetreiber, Gruppenadmins oder langjährige Nutzer handelt – der technische Ablauf unterscheidet sich kaum. Der einzelne Nutzer mag wechseln, das System dahinter nicht.

„Das kenne ich – genau so lief es bei mir auch“

Besonders auffällig ist, wie häufig Betroffene exakt dieselben Formulierungen schildern. Teilweise wortgleich. Das deutet stark darauf hin, dass es sich nicht um individuelle Entscheidungen handelt, sondern um standardisierte, automatisierte Prozesse.

Auch Alexander beschreibt nichts Exotisches oder Ungewöhnliches. Im Gegenteil: Sein Fall fügt sich nahtlos in eine ganze Reihe ähnlicher Berichte ein. Das betrifft:

- die Art der Identitätsprüfung

- die fehlende Begründung

- die fehlende Alternativlösung

- und die endgültige Konsequenz bei Nicht-Mitmachen

Gerade die Tatsache, dass selbst sehr alte Konten betroffen sind, taucht immer wieder auf. Das widerspricht der verbreiteten Annahme, solche Maßnahmen träfen vor allem neue oder auffällige Accounts.

Parallelen zu bereits dokumentierten Fällen auf aufgedeckt24.de

Auch auf aufgedeckt24.de wurde dieses Thema bereits behandelt – unter anderem anhand eines eigenen Erfahrungsberichts. Wichtig ist hier die Abgrenzung: Alexanders Fall ist kein Aufguss dieser Geschichte, sondern ein weiterer Baustein, der zeigt, dass es sich nicht um einen Einzelfall handelt.

Die Parallelen sind trotzdem unübersehbar:

- Video-Ident als alleiniger „Ausweg“

- keine echte Einspruchsmöglichkeit

- automatisierte Ablehnung oder Unsicherheit über den Ausgang

- vollständiger Kontrollverlust auf Nutzerseite

Gerade diese Wiederholbarkeit macht die Sache so problematisch. Denn sie zeigt: Das ist kein Ausrutscher, sondern Teil einer systematischen Vorgehensweise.

Unabhängig vom Inhalt – der Ablauf bleibt gleich

Ein weiterer wichtiger Punkt: Die Fälle unterscheiden sich oft massiv im Inhalt. Manche berichten von politischen Diskussionen, andere von völlig banalen Aktivitäten. Wieder andere waren kaum aktiv oder nutzten Facebook nur privat.

Und trotzdem läuft der Prozess gleich ab.

Das spricht gegen die Idee, dass es hier um konkrete Regelverstöße geht. Vielmehr entsteht der Eindruck, dass bestimmte Muster, Trigger oder automatisierte Bewertungen ausreichen, um einen Account in dieses Verfahren zu schieben – ohne individuelle Prüfung, ohne Kontext, ohne Erklärung.

Das eigentliche Problem: Austauschbarkeit

Was all diese Fälle verbindet, ist nicht nur der technische Ablauf, sondern das Gefühl der Betroffenen, austauschbar zu sein. Egal, wie lange man dabei ist. Egal, wie regelkonform man sich verhält. Egal, ob man privat oder öffentlich unterwegs ist.

Sobald das System greift, reduziert sich alles auf eine einzige Frage:

Machst du mit – oder nicht?

Wer nicht mitmacht, verschwindet. Und zwar endgültig.

Warum diese Parallelen so wichtig sind

Gerade weil Alexanders Fall kein Einzelfall ist, bekommt er Gewicht. Es geht nicht um eine persönliche Auseinandersetzung mit Facebook, sondern um ein strukturelles Problem:

- automatisierte Entscheidungen

- fehlende Transparenz

- keine echte Wahlfreiheit

- und ein Verfahren, das immer gleich abläuft

Das macht es für Betroffene schwer – und für Außenstehende umso wichtiger, genau hinzuschauen.

Im nächsten Kapitel geht es deshalb um den Punkt, an dem all diese Parallelen zusammenlaufen: Was Facebook nicht anbietet – nämlich Transparenz, Kommunikation und einen echten Widerspruch.

Transparenz und Widerspruch: Was Facebook nicht anbietet

Wenn man Alexanders Fall (und die vielen ähnlichen Fälle) auf einen gemeinsamen Nenner bringt, dann ist es nicht mal die Video-Ident-Prüfung. Die ist „nur“ das Werkzeug. Das eigentliche Problem liegt darunter:

Facebook verlangt etwas – aber erklärt fast nichts.

Und wenn man nicht mitzieht, gibt es keinen fairen Weg zurück.

Das klingt hart, ist aber genau der Punkt, an dem viele Nutzer irgendwann nicht mehr über „Sicherheit“ reden, sondern über Willkür.

Keine klare Begründung: „Bot“ als Platzhalter

Alexander bekam sinngemäß die Meldung:

„Um sicherzugehen, dass Sie kein Bot sind …“

Das wirkt zunächst wie ein konkreter Grund, ist aber in Wahrheit eher eine Etikette. Denn die entscheidenden Fragen bleiben unbeantwortet:

- Warum genau glaubt Facebook, dass er ein Bot ist?

- Was war der Auslöser? Ein Kommentar? Ein Login? Ein Muster?

- Gab es verdächtige Anmeldeversuche?

- Wurde der Account gemeldet?

- War es ein automatischer Treffer?

Für den Betroffenen sieht das Ganze so aus: Das System hat entschieden – und der Nutzer soll jetzt beweisen, dass das System sich irrt. Ohne zu wissen, was überhaupt „verdächtig“ gewesen sein soll.

Und das ist der erste Transparenzbruch: Man kann sich gegen etwas kaum wehren, wenn man nicht mal weiß, was einem konkret vorgeworfen wird.

Keine Einsicht in den Prozess: Blackbox mit Kamera

Dann kommt die nächste Stufe: Video-Ident.

Auch hier stellt sich für Nutzer sofort eine ganze Reihe nachvollziehbarer Fragen:

- Wer bewertet das Video – ein Mensch oder ein Algorithmus?

- Welche Kriterien werden geprüft?

- Was passiert, wenn die Erkennung fehlschlägt?

- Wird das Video gespeichert? Wenn ja: wie lange?

- Wird es mit anderen Daten verknüpft?

Facebook liefert dazu in der Situation selbst meist nur das Nötigste. Für Betroffene fühlt sich das an wie:

„Mach das jetzt – frag nicht.“

Das ist zwar für einen automatisierten Prozess bequem, aber für Nutzer schlicht ein Albtraum. Denn hier geht es nicht um „Klick auf OK“, sondern um biometrische Daten.

Kein echter Widerspruch: Du kannst nicht „gegenhalten“

Der nächste Punkt ist der, der am meisten frustriert: Selbst wenn man die Maßnahme problematisch findet, gibt es keine klassische Möglichkeit zu sagen:

- „Moment, da muss ein Fehler vorliegen.“

- „Bitte prüft das manuell.“

- „Ich lege Widerspruch ein.“

- „Ich möchte wissen, worauf das basiert.“

Das System bietet in der Regel keinen echten Dialog. Es ist ein Einbahnstraßen-Prozess: Facebook fordert – der Nutzer liefert. Wenn nicht, endet es im Verlust.

Und genau damit fehlen die Basics, die man aus anderen Bereichen kennt:

- keine Anhörung

- keine nachvollziehbare Begründung

- kein menschlicher Ansprechpartner

- keine echte zweite Instanz

Das ist das Gegenteil von fair.

Keine Alternative: nur dieser eine Weg

Was diese Verfahren besonders unsympathisch macht: Es gibt nicht „mehrere Möglichkeiten“, sondern nur diese eine. Keine Ausweichroute, kein „machen Sie stattdessen X“. Kein:

- „Bestätigen Sie per Ausweis“ (ohne Video)

- „Bestätigen Sie per Brief“ (wie früher bei Banken)

- „Bestätigen Sie per Sicherheitsfeatures“ (2FA, Login-Verlauf etc.)

Stattdessen heißt es sinngemäß: Video oder nichts.

Und je weniger Alternativen es gibt, desto stärker fühlt es sich nicht mehr nach „Sicherheit“ an, sondern nach „Bedingung zum Weitermachen“.

Keine Kommunikation: kein Support, der seinen Namen verdient

Ein weiterer Klassiker: Du kannst niemanden erreichen. Kein Ticket, keine Hotline, kein „Wir melden uns innerhalb von 48 Stunden“. In vielen Fällen besteht der gesamte Kontakt aus:

- automatischen Masken

- Textbausteinen

- starren Abläufen

Für große Unternehmen ist das effizient. Für Nutzer ist es entmenschlichend. Und gerade bei so drastischen Folgen wie Kontolöschung ist das ein Problem. Denn damit hängt für viele nicht nur ein Profil dran, sondern:

- Kontakte und Nachrichten

- Seiten und Projekte

- berufliche Reichweite

- oder schlicht: Jahre an Inhalten

Wenn so etwas per Autopilot entschieden wird und niemand erreichbar ist, entsteht zwangsläufig der Eindruck: Du bist nicht Kunde, du bist ein Datenpunkt.

Warum das alles mehr ist als „nervig“

Man könnte sagen: „Okay, dann geh halt von Facebook weg.“

Das ist leicht gesagt – aber in der Praxis ist Facebook für viele:

- Kommunikationskanal

- Reichweiten-Plattform

- Werkzeug für Projekte

- Teil des sozialen Umfelds

Genau deshalb ist Transparenz so wichtig. Wenn ein Konzern mit dieser Reichweite Accounts in Sekunden in die Sackgasse schicken kann, ohne nachvollziehbare Begründung und ohne Widerspruch, dann betrifft das nicht nur Einzelfälle – sondern das Grundprinzip, wie digitale Öffentlichkeit heute funktioniert.

Zwischenfazit

Alexanders Fall zeigt nicht nur ein Video-Ident-Problem, sondern ein viel grundlegenderes:

- Facebook erklärt nicht, was konkret los ist.

- Facebook bietet keinen fairen Widerspruch.

- Facebook lässt keine echte Alternative zu.

- Facebook kommuniziert nicht wie ein Dienstleister, sondern wie ein Automat.

Und genau dadurch entsteht diese Schieflage, die viele Betroffene als „machtlos“ beschreiben: Man soll etwas beweisen – gegenüber einem System, das nichts erklären muss.

Im nächsten Kapitel schauen wir deshalb kurz auf die juristische Seite – nicht als trockenes Gesetzes-Geplänkel, sondern als Antwort auf eine einfache Frage:

Darf eine Plattform das so einfach – oder gibt es Pflichten zu Begründung und Anhörung?

Rechtliche Einordnung (Kurzüberblick)

Vorweg, damit das hier nicht in eine Juravorlesung abdriftet: Ich bin kein Anwalt. Trotzdem gibt es inzwischen klare rechtliche Leitplanken, die für Fälle wie den von Alexander relevant sind. Denn auch wenn Facebook bzw. Meta sich auf Hausrecht und eigene Nutzungsbedingungen beruft, bedeutet das nicht, dass Konten beliebig blockiert oder zur Löschung gedrängt werden dürfen – insbesondere nicht ohne nachvollziehbare Begründung oder eine echte Möglichkeit zur Gegenwehr.

Konto blockiert, Löschung angedroht – rechtlich kein Bagatellfall

Wird ein Nutzerkonto faktisch vollständig unbenutzbar gemacht und gleichzeitig mit der endgültigen Löschung bedroht, handelt es sich rechtlich nicht mehr um eine Kleinigkeit. In solchen Fällen liegt ein erheblicher Eingriff in das bestehende Nutzungsverhältnis zwischen Plattform und Nutzer vor. Genau deshalb greifen hier Anforderungen an Transparenz, Begründung und ein faires Verfahren.

(Quelle: allgemeine zivilrechtliche Grundsätze zum Vertragsverhältnis zwischen Plattformbetreiber und Nutzer)

Bundesgerichtshof: Sperren nicht ohne Begründung und Anhörung

Der Bundesgerichtshof hat bereits entschieden, dass soziale Netzwerke Nutzerkonten nicht ohne nachvollziehbare Begründung sperren dürfen. Betroffene müssen grundsätzlich darüber informiert werden, warum eine Maßnahme ergriffen wird, und sie müssen Gelegenheit erhalten, dazu Stellung zu nehmen. Pauschale Hinweise auf „Gemeinschaftsstandards“ reichen dafür nicht aus, wenn kein konkreter Bezug zum Einzelfall hergestellt wird.

(Quelle: BGH, Urteil vom 29.07.2021, Az. III ZR 179/20)

Digital Services Act (DSA): Begründungspflicht und Beschwerdemöglichkeit

Mit dem Digital Services Act (DSA) gelten diese Anforderungen inzwischen auch ausdrücklich auf europäischer Ebene. Online-Plattformen sind verpflichtet, bei Kontobeschränkungen oder -maßnahmen eine klare und verständliche Begründung zu liefern. Außerdem müssen sie ein internes Beschwerdesystem bereitstellen, über das Nutzer Entscheidungen anfechten können.

(Quelle: Digital Services Act, Art. 17 und Art. 20)

Darüber hinaus sieht der DSA vor, dass Nutzer Entscheidungen von Plattformen auch über außergerichtliche Streitbeilegungsstellen überprüfen lassen können. Ziel ist es ausdrücklich, automatisierte oder intransparente Entscheidungen nicht unangreifbar zu machen.

(Quelle: Digital Services Act, Art. 21)

Was das für Fälle wie diesen bedeutet

Übertragen auf Alexanders Situation heißt das: Nicht jede Sicherheitsmaßnahme ist automatisch unzulässig. Problematisch wird es aber dort, wo eine Plattform pauschal handelt, keine konkrete Begründung liefert, keine echte Beschwerdemöglichkeit anbietet und die Entscheidung faktisch unumkehrbar macht. Genau an dieser Stelle kann es zu Konflikten mit den genannten rechtlichen Anforderungen kommen.

(Quelle: Auslegung der genannten Rechtsprechung und DSA-Vorgaben)

Datenschutz als zusätzlicher Aspekt

Bei Video-Ident-Verfahren geht es zwangsläufig um besonders sensible Daten, da Gesichtsdaten und Bewegungen verarbeitet werden. Meta beschreibt in eigenen Richtlinien zwar, wie solche Video-Selfies genutzt und gespeichert werden sollen, dennoch bleiben für Betroffene im Einzelfall häufig Fragen offen – insbesondere zur konkreten Verarbeitung und Entscheidungslogik.

(Quelle: Meta Platforms, Informationen zur Identitätsbestätigung per Video-Selfie)

Einordnung durch aufgedeckt24.de

Nach all den Details, Abläufen und rechtlichen Leitplanken stellt sich zwangsläufig die Frage: Wie ist das Ganze einzuordnen? Nicht juristisch bis ins letzte Komma, sondern aus der Perspektive eines Projekts, das sich genau mit solchen Fällen beschäftigt.

Es geht nicht um einen Einzelfall

Was Alexanders Bericht zeigt – und was sich mit vielen anderen Fällen deckt – ist kein Ausrutscher und kein bedauerlicher Einzelfehler. Der Ablauf ist zu standardisiert, zu wiederholbar, um ihn als Ausnahme abzutun. Checkpoint, Video-Ident, Frist, Drohung mit endgültiger Löschung – das ist ein festes Muster.

Und genau das ist der Punkt, an dem man stutzig werden muss. Denn wenn ein System immer wieder gleich reagiert, unabhängig davon, wie alt ein Account ist oder wie er genutzt wurde, dann geht es nicht mehr um individuelles Fehlverhalten, sondern um Struktur.

Sicherheit als Begründung – ohne echte Nachvollziehbarkeit

Natürlich braucht eine Plattform wie Facebook Sicherheitsmechanismen. Niemand bestreitet, dass Bot-Netze, Fake-Profile oder automatisierte Kampagnen ein reales Problem sind. Der entscheidende Punkt ist aber: Sicherheit darf keine Blackbox sein.

Im vorliegenden Fall bleibt offen:

- warum genau dieser Account auffällig geworden ist,

- welche Kriterien angewendet wurden,

- und warum es keine mildere oder alternative Maßnahme gibt.

Sicherheit wird hier zur Begründung – nicht zur Erklärung. Und genau diese Unschärfe ist problematisch.

Die Macht liegt einseitig bei der Plattform

Was besonders auffällt: Das gesamte Verfahren ist einseitig. Facebook entscheidet, Facebook fordert, Facebook setzt die Frist. Der Nutzer kann reagieren – aber nur innerhalb eines sehr engen Rahmens. Es gibt keinen echten Dialog, keine Verhandlung auf Augenhöhe und keine transparente Überprüfung.

Das mag technisch effizient sein, ist aber menschlich und gesellschaftlich eine Schieflage. Denn für den Nutzer steht viel auf dem Spiel, während die Plattform keinerlei Risiko trägt.

Wahlfreiheit nur auf dem Papier

Formal gesehen gibt es eine Wahl: Video-Ident durchführen oder nicht. In der Realität ist diese Wahl stark verzerrt. Wer sein Konto behalten möchte, soll zustimmen. Wer Bedenken hat, verliert alles.

Das ist keine offene Entscheidung, sondern eine faktische Alternativlosigkeit. Und genau das widerspricht dem Bild einer „freiwilligen Sicherheitsmaßnahme“, das gerne vermittelt wird.

Besonders problematisch für normale Nutzer und kleine Projekte

Für große Seiten, Unternehmen oder Influencer mit mehreren Kanälen ist ein verlorenes Facebook-Konto ärgerlich, aber oft kompensierbar. Für normale Nutzer, Solo-Projekte oder kleinere Initiativen kann es dagegen existenziell sein.

Kontakte, Reichweite, Kommunikation – all das hängt häufig an genau diesem einen Account. Wird der blockiert oder gelöscht, ist nicht nur ein Profil weg, sondern oft ein ganzes Stück digitaler Alltag.

Transparenz wäre der einfachste Ausweg

Was den Fall so unnötig eskaliert, ist nicht die Existenz einer Sicherheitsprüfung, sondern deren Umsetzung. Mit klaren Informationen, alternativen Verifizierungswegen und einem echten Widerspruchsprozess ließe sich viel Druck aus der Situation nehmen.

Dass all das fehlt, ist keine technische Notwendigkeit – es ist eine bewusste Entscheidung.

Fazit der Einordnung

Aus Sicht von aufgedeckt24.de zeigt Alexanders Fall sehr deutlich, wie sich Plattformmacht im Alltag auswirkt: nicht durch offene Zensur oder spektakuläre Sperren, sondern durch automatisierte Prozesse, Intransparenz und Entscheidungszwang.

Es geht dabei weniger um Facebook als Plattform, sondern um ein Grundproblem moderner digitaler Abhängigkeit. Wer zentrale Kommunikationsräume kontrolliert, trägt Verantwortung – nicht nur technisch, sondern auch gesellschaftlich.

Und genau deshalb gehört dieser Fall öffentlich gemacht, eingeordnet und kritisch begleitet. Nicht, um Empörung zu erzeugen, sondern um sichtbar zu machen, wie schnell man in ein System geraten kann, aus dem es keinen fairen Ausweg mehr gibt.

Im letzten Kapitel ziehen wir noch einmal ein klares Fazit und stellen die entscheidende Frage: Was bleibt Nutzern in solchen Situationen eigentlich noch übrig?

Fazit: Wenn „freiwillige Verifikation“ zur Bedingung wird

Am Ende ist Alexanders Fall erschreckend simpel – und genau das macht ihn so beunruhigend. Facebook nennt es Sicherheitsmaßnahme, vielleicht sogar „Schutz“ vor Bots. Für den Nutzer sieht es dagegen so aus:

Du bekommst keinen echten Grund genannt, du bekommst keine Alternative, du bekommst keinen Ansprechpartner – und du sollst trotzdem etwas liefern, das weit über eine normale Sicherheitsabfrage hinausgeht. Ein Video-Selfie, also etwas höchst Persönliches. Und wenn du das nicht machst, läuft eine Frist ab und dein Konto wird dauerhaft gelöscht.

Das ist der Kern. Und der Kern ist nicht „Sicherheit“, sondern Bedingung.

„Freiwillig“ ist hier nur ein Label

Man kann eine Verifikation nur dann freiwillig nennen, wenn man sie auch ablehnen kann, ohne dafür bestraft zu werden. Genau das ist hier nicht der Fall. Wer ablehnt, verliert sein Konto. Wer zustimmt, hofft auf Freigabe – ohne Garantie, ohne transparente Prüfung, ohne echte Kontrolle.

Das ist keine Verifikation im Sinne von „optional“, sondern eine Art Eintrittskarte: Ohne Video kein Zutritt.

Und genau deshalb ist dieser Mechanismus so problematisch: Er verschiebt die Grenze dessen, was Plattformen von Nutzern verlangen können, ohne sich erklären zu müssen.

Was dieser Fall wirklich zeigt

Alexanders Bericht ist kein technischer Sonderfall, sondern ein Beispiel dafür, wie Plattformen heute funktionieren können:

- Entscheidungen laufen automatisiert

- Begründungen bleiben pauschal

- Widerspruch wird zur Formsache oder existiert praktisch nicht

- und die Konsequenzen tragen ausschließlich die Nutzer

Der Nutzer muss beweisen, dass er „echt“ ist – während die Plattform nicht beweisen muss, warum sie überhaupt zweifelt.

Warum das jeden treffen kann

Viele denken bei Bots an frisch erstellte Fake-Accounts, offensichtlichen Spam oder dubiose Profile. Alexanders Hinweis zeigt aber: Selbst ein Konto, das – laut seiner Aussage – seit rund 20 Jahren existiert, kann plötzlich in dieses Raster fallen.

Das heißt: Niemand kann sich darauf verlassen, „zu alt“ oder „zu unauffällig“ zu sein, um betroffen zu sein. Ein falscher Trigger, ein unglückliches Muster, eine automatisierte Bewertung – und plötzlich sitzt man in derselben Sackgasse.

Was man als Nutzer daraus mitnehmen sollte

Ohne hier in Ratgeber-Alarmismus zu verfallen: Dieser Fall liefert ein paar klare Lehren, die man nicht ignorieren sollte:

Erstens: Verlass dich nicht darauf, dass Plattformen fair reagieren.

Wenn ein Prozess automatisiert und intransparent ist, kann er auch falsch liegen – und du hast im Zweifel wenig Möglichkeiten, das zu korrigieren.

Zweitens: Nimm digitale Abhängigkeiten ernst.

Wer ein Projekt, eine Seite oder eine Community auf einer einzigen Plattform aufbaut, baut auf fremdem Grund. Und fremder Grund kann jederzeit entzogen werden.

Drittens: Backup ist kein Luxus.

Wer Inhalte, Kontakte oder wichtige Kommunikation auf Facebook hat, sollte sich überlegen, wie man das zumindest teilweise absichert oder alternative Kanäle aufbaut. Nicht, weil Facebook „böse“ ist, sondern weil man als Nutzer am Ende immer derjenige ist, der den Schaden trägt.

Und was bleibt Alexander?

Alexander hat für sich eine klare Linie gezogen: Er will diese Video-Ident-Prüfung nicht machen, weil er nicht weiß, wer sein Video sieht, wie es geprüft wird und was damit passiert. Das ist sein gutes Recht – aber es ist bitter, dass ihn diese Entscheidung vermutlich sein Konto kosten kann.

Und genau das ist der eigentliche Skandal: Nicht die Verifikation an sich, sondern dass man sie nicht verweigern kann, ohne alles zu verlieren.

Schlusswort

Alexanders Fall steht exemplarisch für eine Entwicklung, die man nicht einfach hinnehmen sollte: Plattformen, die sich immer mehr wie Behörden verhalten – nur ohne Begründungspflicht, ohne Anhörung und ohne Rechtsmittel auf Knopfdruck.

Wenn „freiwillige Verifikation“ zur Bedingung wird, dann ist das keine Sicherheitsfunktion mehr, sondern ein Machtinstrument. Und das betrifft nicht nur Menschen, die „irgendwas falsch gemacht haben“, sondern potenziell jeden, der irgendwann ins Raster fällt.

Wenn du Ähnliches erlebt hast: Du kannst mir deinen Fall über das Hinweisformular auf aufgedeckt24.de schicken. Je mehr dokumentierte Fälle sichtbar werden, desto schwerer wird es, das Ganze als „Einzelfall“ abzutun.

Bekommen Sie eigentlich Geld für jedes Wort, welches Sie in diesem Artikel verbauen ? : gefühlte 90 Prozent sind sich ständig wiederholendes Blabla.

Was ist denn nun zu empfehlen ?!:

-Anwalt kontaktieren ?

-Die Verbraucherschutz-Zentrale informieren ?

Vielen Dank für Ihren Kommentar.

Der Artikel ist bewusst ausführlich gehalten, um Ablauf, Hintergründe und rechtliche Einordnung nachvollziehbar darzustellen. Wer nur eine Kurzfassung sucht, findet das Wesentliche im Fazit.

Zu Ihrer Frage:

Ob ein Anwalt sinnvoll ist, hängt vom Einzelfall ab. Bei gewerblichen Accounts oder erheblichem Schaden kann eine anwaltliche Prüfung durchaus angebracht sein.

Die Verbraucherzentrale kann ebenfalls ein Ansprechpartner sein, insbesondere wenn viele ähnliche Fälle auftreten und strukturelle Probleme vermutet werden.

Unabhängig davon ist es wichtig, solche Fälle öffentlich zu dokumentieren – Transparenz entsteht nur, wenn Betroffene darüber sprechen.

Hallo Zusammen,

ich bin genauso betroffen, wie Alexander, habe mein Account seit mehr als 10 Jahren, war im Grunde ein harmloser Austausch mit Freunden, Bekannten, die man sonst wahrscheinlich auf der Straße nicht angesprochen hätte, trotzem immer wieder interessanter Austausch. Nun ich wurde aus dem NICHTS aufgefordert, mein Video zu machen. Da ich aber in den letzten Jahren sehr vorsichtig geworden bin, genau aus dem gleichen Gründen wie Alexander. Habe dies nicht gemacht. Denn ich möchte nicht, irgendwo im System gespeichert werden, möchte nicht: rein theoretisch – jemand ähnelt mir in ca. 80 % (so was gibt es) Gesichtszüge, Wangen etc. macht irgendeinem Mist, dann muss ich mich dafür rechtfertigen, dass ich es nicht war. Da kann man „Zwang“ nennen, aber gerade beim nicht ausgereiften Maschinen, die die Daten speichern, als wahr, die nicht 100 % funktionieren. Auf so etwas werde ich mich nicht verlassen. Allerdings ich weiß, warum ich gesperrt worden bin, ich habe etliche Berichte zum Epsteinfall gelesen, mich informiert, wie krank so manche Menschen sind. Im welchem System wir bereits leben, es ist einfach sehr beunruhigt. Wir werden in ein paar Jahren von Maschinen gesteuert, bewertet, eingeordnet, es ist so krank. Da ich bei Facebook nichts zu verlieren habe, außer ein paar Leute, mit denen man sich ausgetauscht hat, (die meinsten habe ich schon so gespeichert, dass Facebook mir diese nicht wegnehmen kann 🙂 ) werde ich das Konto verlieren, aber aus einem guten Grund, ich lasse nicht zu, dass irgenwelche kranke Menschen über mich macht haben. Vielleicht sollten mehr Menschen Facebook verlassen, bin dann gespannt, was damit passiert, keine Werbeeinnahmen, nichts mehr 🙂 Im übrigen vor ca. 5 Jahren hat man mich tatsächlich bereits geprüft mit meinem Ausweis. Also was soll ich dazu noch sagen 🙂 schreiben 🙂

Allen noch einen schönen Tag

Paola

Hallo Paola,

vielen Dank für Ihren ausführlichen Kommentar und dass Sie Ihre Erfahrung hier teilen.

Ihr Fall zeigt sehr deutlich, dass es sich nicht um Einzelfälle handelt – insbesondere, wenn selbst langjährige Accounts plötzlich und ohne konkrete Begründung in solche Prüfprozesse geraten.

Es gibt inzwischen immer wieder Berichte über ähnliche Fälle – darunter auch Nutzer, die ihre Konten über viele Jahre hinweg völlig unauffällig genutzt haben und dann plötzlich mit pauschalen Begründungen wie „Betrug“ oder „Richtlinienverstoß“ ausgeschlossen werden, ohne dass konkret nachvollziehbar ist, was überhaupt vorgeworfen wird (siehe auch mein Beitrag zu einem ähnlichen Fall).

Ihre Entscheidung, die Video-Verifizierung nicht durchzuführen, ist absolut nachvollziehbar. Gerade wenn man sich mit dem Thema Datenschutz und automatisierter Auswertung beschäftigt, stellt sich zwangsläufig die Frage, was mit solchen Daten passiert und wie zuverlässig diese Verfahren tatsächlich sind.

Wichtig ist aus meiner Sicht vor allem der Punkt, den Sie indirekt ansprechen:

Es gibt faktisch keine echte Wahl. Entweder man stimmt der geforderten Maßnahme zu – oder man verliert den Zugriff auf sein Konto. Genau diese „Alles oder nichts“-Situation ist der Kern des Problems.

Was mögliche Ursachen angeht (z. B. bestimmte Inhalte oder Themen), bleibt Facebook leider extrem intransparent. Selbst wenn ein Zusammenhang besteht, wird er den Betroffenen in der Regel nicht konkret mitgeteilt.

Umso wichtiger ist es, dass solche Erfahrungen öffentlich gemacht werden. Nur so entsteht überhaupt ein Gesamtbild.

Danke nochmals für Ihren Beitrag.

Freundliche Grüße

Thomas

Hallo, gerade eben ist mir dasselbe passiert. Ich bin seit ca. 15 Jahren unter meinem Klarnamen bei facebook, tausche mich privat mit Freunden aus und geschäftlich mit Kundinnen, habe mehrere Seiten aufgebaut – auch geschäftliche – und administriere 2 Gruppen. Ich diskutiere unter Nachrichtenseiten auch politisch. Ohne jede Vorankündigung soll ich nun plötzlich per Video-Selfie nachweisen, dass ich kein Bot bin. Mein erster Reflex ist, das nicht zu tun, ich würde dadurch aber tatsächlich viele Kontakte und ein Netzwerk verlieren.

Hallo Susanne,

du beschreibst die Situation leider sehr treffend – und ich muss ein paar Dinge ganz klar ergänzen:

Es ist nicht nur ein „Risiko“, den Account zu verlieren.

Wenn du die Verifizierung nicht durchführst, ist der Account nach Ablauf der Frist weg.

Und genau das macht die ganze Sache so problematisch.

Du wirst hier nicht gefragt – du wirst vor eine Entscheidung gestellt:

Entweder du gibst dein Video-Selfie ab oder dein digitales Leben verschwindet.

Gerade bei dir ist das besonders kritisch:

• 15 Jahre Account

• private Kontakte

• geschäftliche Nutzung

• Gruppen, die du verwaltest

Das ist längst kein „Social Media Profil“ mehr, sondern ein gewachsenes Netzwerk.

Und wie drastisch das enden kann, zeigt ein besonders krasser Fall:

👉 Facebook-Konto nach 22 Jahren gesperrt

Eine 83-jährige Nutzerin wurde nach über zwei Jahrzehnten einfach entfernt – mit der Begründung „Betrug und Richtlinienverstoß“. Ohne echte Erklärung, ohne erreichbaren Support.

Und jetzt kommt der Punkt, der das Ganze endgültig kippt:

Selbst wenn man das Video-Selfie macht, gibt es keinerlei Garantie, dass der Account zurückkommt.

Es gibt zahlreiche Berichte – und ich gehöre selbst dazu – bei denen die Verifizierung durchgeführt wurde und anschließend trotzdem die Mitteilung kam, dass das Konto dauerhaft gesperrt bleibt.

Das bedeutet im Klartext:

• Du gibst biometrische Daten preis

• erfüllst die geforderte Maßnahme

• und verlierst am Ende trotzdem deinen Account

Damit wird aus einer „Sicherheitsmaßnahme“ ein System ohne verlässlichen Ausgang.

Offiziell soll das Ganze Fake-Accounts und Betrug verhindern.

In der Praxis trifft es aber auch ganz normale Nutzer – ohne Vorwarnung, ohne nachvollziehbare Begründung und ohne echte Möglichkeit, sich zu wehren.

Du stehst damit vor einer Entscheidung, die eigentlich keine ist:

• Video machen → keine Garantie, aber Daten abgeben

• Nicht machen → Account sicher weg

Das ist kein fairer Prozess mehr – das ist ein erzwungenes Glücksspiel.

Du bist damit definitiv nicht allein.